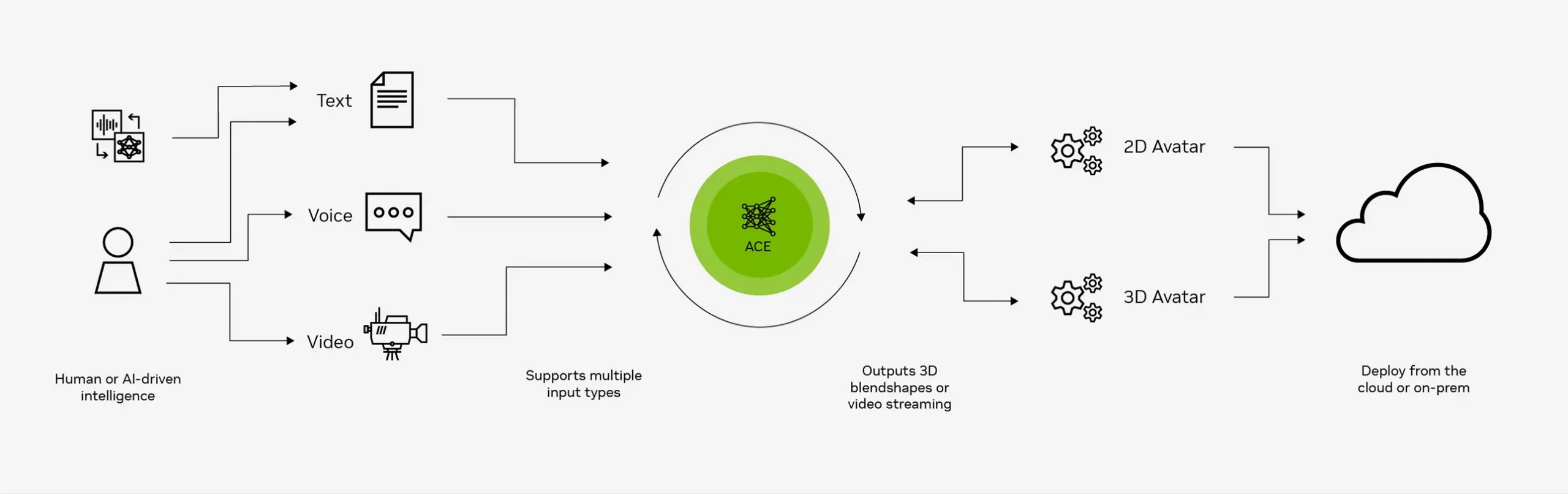

Al Computex 2023 è stato annunciato NVIDIA Avatar Cloud Engine (ACE) for Games, un servizio di modelli AI personalizzati che trasforma i giochi conferendo intelligenza ai personaggi non giocabili (NPC) attraverso interazioni in linguaggio naturale basate sull’AI.

Gli sviluppatori di middleware, strumenti e giochi possono utilizzare ACE for Games per creare e distribuire modelli AI personalizzati di parlato, conversazione e animazione nei loro software e giochi.

In pratica, gli sviluppatori non dovranno più sceneggiare i dialoghi in fase di sviluppo, ma potranno delineare delle linee guida e poi sarà l’AI a creare i dialoghi sul momento.

Gli scenari che si aprono a questo punto sono molteplici: potremo avere esperienze sempre diverse e differenti da giocatore a giocatore.

Indice

Cos’è Nvidia ACE, tecnologie integrate e come potrebbe rivoluzionare lo sviluppo dei giochi

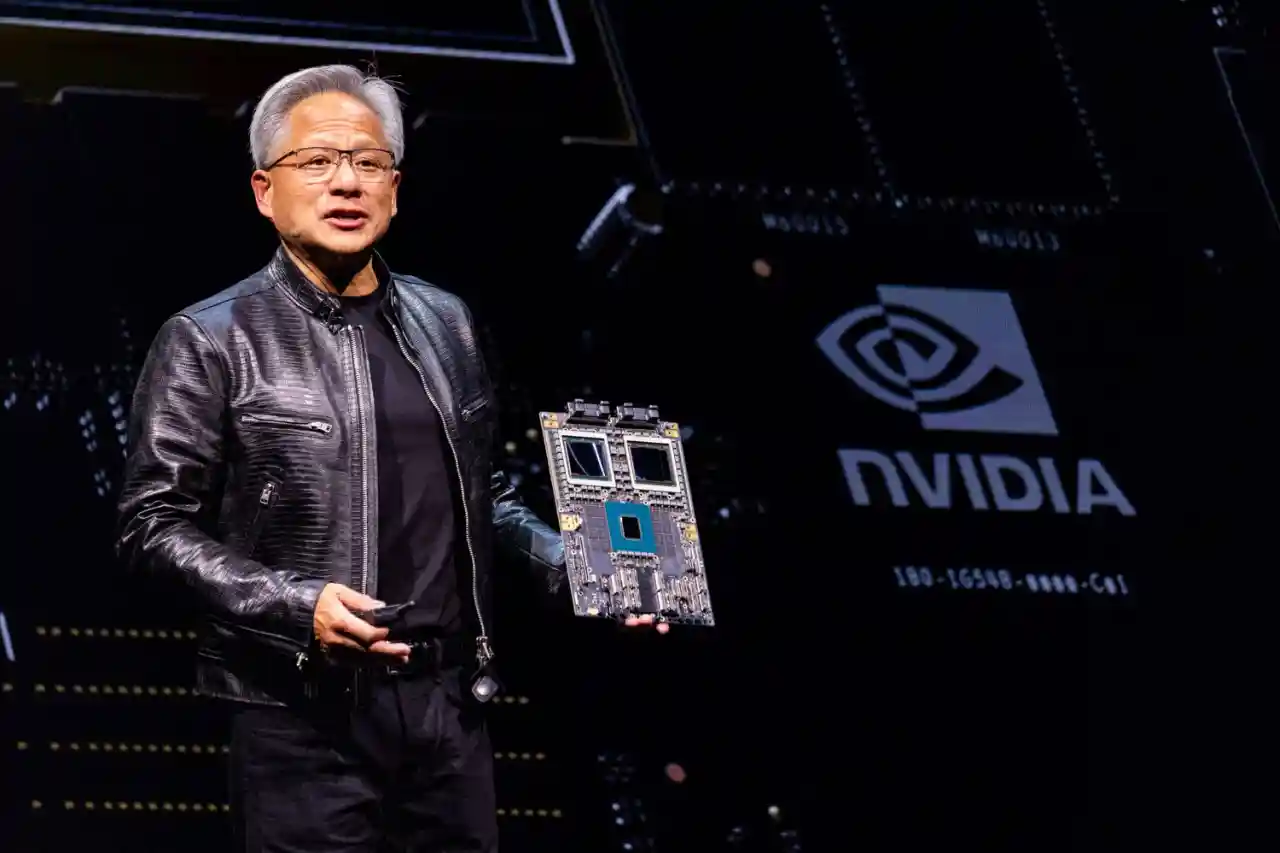

Il CEO di Nvidia Jensen Huang è salito sul palco del Computex e ha annunciato, tra le tante novità per il Team Verde, anche ACE. Scopriamo di che si tratta direttamente dalle parole dei dirigenti di Nvidia.

“L’IA generativa ha il potenziale per rivoluzionare l’interattività che i giocatori possono avere con i personaggi dei giochi e aumentare drasticamente l’immersione nei giochi”, ha dichiarato John Spitzer, vicepresidente della divisione Developer and Performance Technology di NVIDIA.

“Basandosi sulle nostre competenze in materia di IA e su decenni di esperienza di collaborazione con gli sviluppatori di videogiochi, NVIDIA è all’avanguardia nell’uso dell’IA generativa nei giochi”.

IA – AI generativa pionieristica nei giochi

Basandosi su Nvidia Omniverse, ACE for Games offre modelli di base di IA ottimizzati per il parlato, la conversazione e l’animazione dei personaggi, fra cui:

- Nvidia NeMo – per la creazione, la personalizzazione e la distribuzione di modelli linguistici, utilizzando dati proprietari. I modelli linguistici di grandi dimensioni possono essere personalizzati con lore e backstory dei personaggi e protetti da conversazioni controproducenti o non sicure tramite NeMo Guardrails.

- Nvidia Riva – per il riconoscimento vocale automatico e il text-to-speech per consentire conversazioni vocali in diretta.

- Nvidia Omniverse Audio2Face – per la creazione istantanea di animazioni facciali espressive di un personaggio di gioco da abbinare a qualsiasi traccia vocale. Audio2Face dispone di connettori Omniverse per Unreal Engine 5, in modo che gli sviluppatori possano aggiungere animazioni facciali direttamente ai personaggi MetaHuman.

Gli sviluppatori possono integrare l’intera soluzione Nvidia ACE for Games o utilizzare solo i componenti necessari.

‘Kairos’ offre una panoramica sul futuro dei giochi

NVIDIA ha collaborato con Convai, una startup di Nvidia Inception, per mostrare come gli sviluppatori potranno presto utilizzare Nvidia ACE for Games per creare PNG. Convai, che si concentra sullo sviluppo di IA conversazionali all’avanguardia per i mondi di gioco virtuali, ha integrato i moduli ACE nella sua piattaforma di avatar in tempo reale end-to-end.

In una demo chiamata Kairos, i giocatori interagiscono con Jin, il proprietario di un negozio di ramen. Pur essendo un PNG, Jin risponde alle domande in linguaggio naturale in modo realistico e coerente con la storia narrata, il tutto con l’aiuto dell’intelligenza artificiale generativa. G

Guardate la demo, renderizzata in Unreal Engine 5 utilizzando le più recenti funzionalità di ray-tracing e NVIDIA DLSS.

“Con Nvidia ACE for Games, gli strumenti di Convai possono raggiungere la latenza e la qualità necessarie per rendere i personaggi non giocabili dotati di intelligenza artificiale disponibili per quasi tutti gli sviluppatori in modo economicamente vantaggioso“, ha dichiarato Purnendu Mukherjee, fondatore e CEO di Convai.

Distribuzione di Nvidia ACE per i modelli di gioco in locale o nel cloud

Le reti neurali che consentono di utilizzare Nvidia ACE for Games sono ottimizzate per diverse capacità, con vari compromessi in termini di dimensioni, prestazioni e qualità.

Il servizio di fonderia ACE for Games aiuterà gli sviluppatori a mettere a punto i modelli per i loro giochi, per poi distribuirli tramite NVIDIA DGX Cloud, PC GeForce RTX o in sede per l’inferenza in tempo reale.

I modelli sono ottimizzati per la latenza – un requisito fondamentale per le interazioni immersive e reattive nei giochi.

IA generativa per trasformare l’esperienza di gioco

Gli sviluppatori di giochi e le startup stanno già utilizzando le tecnologie di IA generativa di Nvidia per i loro flussi di lavoro.

- GSC Game World, uno dei principali sviluppatori di giochi europei, sta adottando Audio2Face nel suo prossimo gioco, S.T.A.L.K.E.R. 2: Heart of Chernobyl.

- Fallen Leaf, uno sviluppatore di giochi indie, sta utilizzando Audio2Face per l’animazione facciale dei personaggi in Fort Solis, un thriller fantascientifico in terza persona ambientato su Marte.

- Charisma.ai, un’azienda che permette di creare personaggi virtuali attraverso l’intelligenza artificiale, utilizza Audio2Face per l’animazione del suo motore di conversazione.

Articoli Correlati

Sviluppare videogiochi con Google Genie 3 è davvero possibile? Ce lo spiega uno sviluppatore

Sviluppare videogiochi con Google Genie 3 è davvero possibile? Ce lo spiega uno sviluppatore SAG-AFTRA ed Ethovox, azienda specializzata in IA, stilano un accordo che mira a salvaguardare gli artisti

SAG-AFTRA ed Ethovox, azienda specializzata in IA, stilano un accordo che mira a salvaguardare gli artisti Per il CEO di Nvidia non si può più fare grafica senza DLSS e intelligenza artificiale

Per il CEO di Nvidia non si può più fare grafica senza DLSS e intelligenza artificiale

PC

PC

Sviluppare videogiochi con Google Genie 3 è davvero possibile? Ce lo spiega uno sviluppatore

Sviluppare videogiochi con Google Genie 3 è davvero possibile? Ce lo spiega uno sviluppatore SAG-AFTRA ed Ethovox, azienda specializzata in IA, stilano un accordo che mira a salvaguardare gli artisti

SAG-AFTRA ed Ethovox, azienda specializzata in IA, stilano un accordo che mira a salvaguardare gli artisti Per il CEO di Nvidia non si può più fare grafica senza DLSS e intelligenza artificiale

Per il CEO di Nvidia non si può più fare grafica senza DLSS e intelligenza artificiale